KI Shopping Assistenten verändern Kaufverhalten

23/03/2026

KI Proteste fordern Entwicklungsstopp großer Modelle

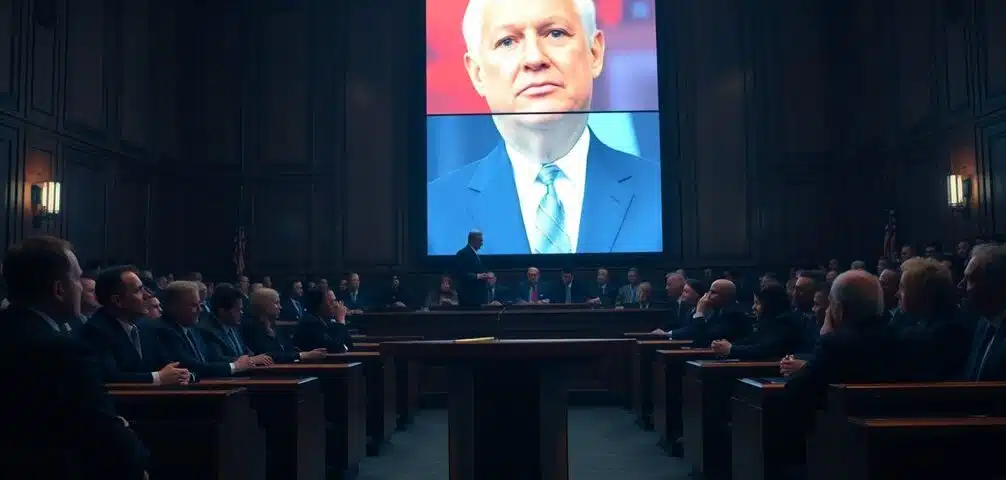

24/03/2026Sie haben möglicherweise schon Videos im Internet gesehen und sich gefragt : “Hat diese Person das wirklich gesagt?”

Deepfakes machen es schwierig, zwischen Real und Fake zu unterscheiden, und das wird zunehmend zu einem großen Problem bei Wahlen.

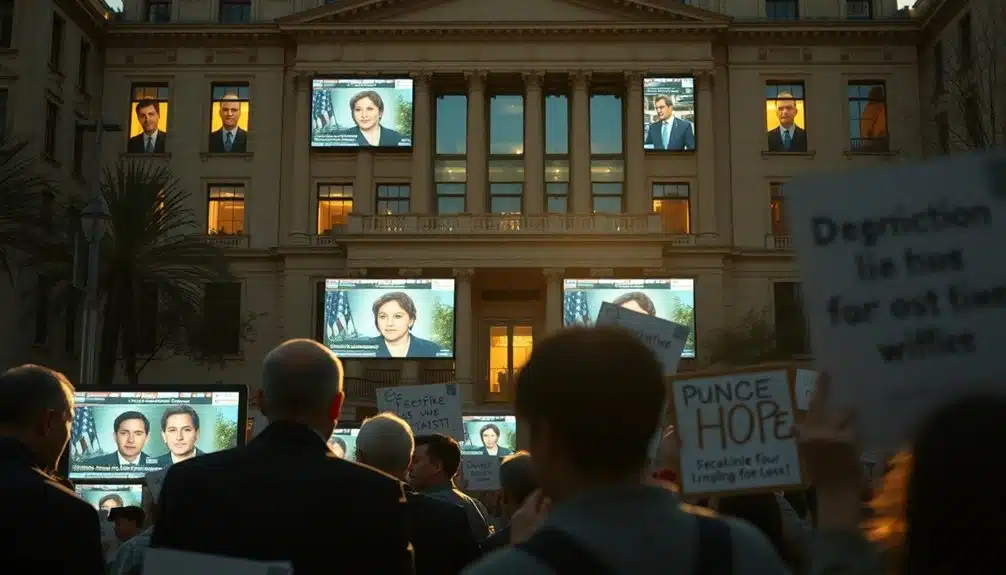

Regierungen auf der ganzen Welt beschleunigen nun die Schaffung neuer Regeln für Künstliche Intelligenz, bevor sich die Situation weiter verschlechtert.

Was ändert sich tatsächlich, und wird es ausreichen, um die Art und Weise, wie wir wählen, zu schützen ?

Lassen Sie uns das herausfinden.

Als künstliche Intelligenz zunehmend Teil alltäglicher Entscheidungen wird , von Bewerbungsverfahren bis hin zu Kreditgenehmigungen , bewegen sich Regierungen weltweit schnell, um Regelungen dafür zu entwickeln. Der Missbrauch von Deepfake-Technologie in jüngsten politischen Wahlkampagnen hat diese Dringlichkeit noch greifbarer gemacht. Sie haben die Schlagzeilen sicher gesehen : Gefälschte Videos, gefälschte Stimmen, echte Konsequenzen. Das hat Gesetzgeber dazu gebracht, nicht länger zu warten und zu handeln.

In den Vereinigten Staaten hat eine Executive Order vom Dezember 2025 den Ton für das Kommende gesetzt. Sie weist Bundesbehörden an, einheitliche Standards zu entwickeln, die ein wachsendes Flickwerk staatlicher Vorschriften ersetzen sollen. Das Ziel ist ein nationales Rahmenwerk, das weniger belastend ist , insbesondere für kleinere Unternehmen, die wachsen wollen. Die Federal Trade Commission bereitet zudem Leitlinien zu unlauteren und irreführenden KI-Praktiken vor. Und die Federal Communications Commission hat lediglich 90 Tage, um Berichtsstandards zu bewerten. Es gibt viele bewegliche Teile, aber die Richtung ist klar , die Bundesführung möchte die Führung übernehmen.

KI-Verantwortlichkeitsrahmen entstehen jedoch nicht im luftleeren Raum. Die Bundesstaaten haben nicht stillgesessen. Rund 38 Staaten haben allein im Jahr 2025 fast 100 KI-bezogene Maßnahmen verabschiedet. Kalifornien schreibt Vorabbenachrichtigungen und Opt-out-Möglichkeiten bei automatisierten Entscheidungen vor. Colorados KI-Gesetz tritt am 30. Juni 2026 in Kraft und umfasst Risikomanagement- und Antidiskriminierungsregeln. Diese Compliance-Herausforderungen auf staatlicher Ebene sind real. Wenn Sie ein Unternehmen in mehreren Bundesstaaten betreiben, fühlt sich das Mithalten wie ein eigenständiger Teilzeitjob an.

Auf der anderen Seite des Atlantiks tritt der EU AI Act am 2. August 2026 in seine zweite Phase ein. Er bringt Transparenzregeln und strengere Verpflichtungen für Hochrisiko-KI-Systeme mit sich. Jeder Mitgliedstaat kann eigene Anforderungen hinzufügen, was bedeutet, dass Sie als Unternehmen, das europäische Kunden bedient, vor einem Zuständigkeits-Puzzle stehen. Eine mögliche digitale Omnibus-Verordnung könnte einige dieser Hochrisiko-Fristen erleichtern, aber noch ist nichts entschieden.

Die Durchsetzung verschärft sich überall. Eine Koalition von Generalstaatsanwälten aus 42 Staaten signalisiert bereits aggressives Vorgehen im Jahr 2026. Regulierungsbehörden schauen nicht mehr nur zu , sie suchen aktiv nach Verstößen bei Einstellungs‑, Kredit- und Preisentscheidungen. Sogar Cyberversicherungen verändern sich, mit neuen KI-Sicherheits-Zusätzen, die dokumentierte Sicherheitspraktiken erfordern, um den Versicherungsschutz aufrechtzuerhalten. Schwerwiegende Verstöße gegen EU-KI-Vorschriften können zu Bußgeldern von bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes eines Unternehmens führen, was zeigt, wie finanziell folgenreich Nichteinhaltung werden kann.

Sie leben in einem bedeutenden Moment. Regierungen reagieren nicht nur auf Deepfakes , sie versuchen, Leitplanken für ein gesamtes technologisches Zeitalter zu errichten. Ob diese Leitplanken Ihre Freiheit schützen oder einschränken, hängt maßgeblich davon ab, wie diese Vorschriften in den nächsten 12 Monaten Gestalt annehmen.

Häufig gestellte Fragen Abschnitt

Was ist ein Deepfake und wie hängt er mit politischen Wahlkampagnen zusammen ?

Ein Deepfake ist KI-generiertes Medienmaterial, das Audio‑, Video- oder Bildinhalte manipuliert, um Personen dabei zu zeigen, wie sie Dinge sagen oder tun, die sie in Wirklichkeit nie getan haben. In politischen Wahlkampagnen werden Deepfakes zunehmend eingesetzt, um irreführende Angriffswerbung zu erstellen, die Kandidaten oder gewählte Amtsträger fälschlicherweise mit Aussagen darstellt, die sie nie gemacht haben. Diese gefälschten Videos können Wahlaussichten beschädigen und das öffentliche Vertrauen in Wahlen untergraben. Forscher haben über 1.000 Bilder und fast 600 Videos dieser Art verfolgt, die auf Social-Media-Plattformen kursieren.

Sind KI-generierte politische Werbeanzeigen in den Vereinigten Staaten illegal ?

Auf Bundesebene gibt es derzeit kein umfassendes Gesetz, das KI-generierte politische Werbung verbietet. Der Kongress und die Bundeswahlkommission hatten bis 2026 keine verbindlichen KI-Regeln für politische Werbung verabschiedet. Einige KI-generierte Wahlkampfinhalte werden als politische Parodie behandelt, die unter dem Ersten Zusatzartikel der Verfassung geschützt ist, insbesondere in Bundesstaaten wie Georgia. Diese regulatorische Lücke macht Sie weitgehend selbst dafür verantwortlich, während Wahlen authentische politische Inhalte von künstlich generierten oder manipulierten Medien zu unterscheiden.

Wie kann man ein Deepfake-Video erkennen ?

Ein häufiger visueller Hinweis auf ein Deepfake-Video ist das unnatürliche Erscheinungsbild der Augen der betroffenen Person, das oft als tot oder glasig wirkend beschrieben wird. Diese subtilen visuellen Anomalien resultieren aus Unvollkommenheiten im KI-Generierungsprozess. Da die Deepfake-Technologie jedoch weiter verbessert wird, werden diese Indikatoren ohne spezialisierte Werkzeuge immer schwerer zu erkennen. Plattformen sind zunehmend durch staatliche Gesetze verpflichtet, modernste Erkennungstechniken einzusetzen, um täuschende synthetische Inhalte während Wahlperioden zu identifizieren und zu entfernen.

Was schreibt Californias Defending Democracy from Deepfake Deception Act von 2025 vor ?

Californias Defending Democracy from Deepfake Deception Act von 2025 verpflichtet Social-Media-Plattformen mit mindestens einer Million Nutzern dazu, täuschende KI-generierte politische Inhalte innerhalb von 72 Stunden nach deren Meldung zu identifizieren und zu entfernen. Plattformen müssen innerhalb von 36 Stunden auf Ihre Meldungen reagieren und diese Regeln in allen Sprachen anwenden. Das Gesetz schreibt außerdem doppelte Offenlegungen bei identifizierten Inhalten vor. Zu den Durchsetzungsmechanismen gehören einstweilige Verfügungen für betroffene Kandidaten und Amtsträger sowie rechtliche Schritte des Generalstaatsanwalts bei Nichterfüllung durch die Plattformen. Die Gesetzgebung legt ferner fest, dass Satire- und Parodieinhalte ausdrücklich von diesen Anforderungen ausgenommen sind, um Raum für geschützten politischen Ausdruck zu bewahren.

Welche Bundesstaaten haben Gesetze erlassen, die speziell auf politische Deepfakes abzielen ?

Mehrere Bundesstaaten haben Gesetze erlassen, die KI-Deepfakes in politischen Zusammenhängen behandeln. Californias Gesetz von 2025 richtet sich gegen täuschende Inhalte auf großen Plattformen während Wahlen. Texas verbietet Deepfake-politische Werbung in der Nähe von Staatswahlen, wobei Bundeswahlen von diesem Verbot ausgenommen sind. New Yorks Gesetz, das im Juni 2026 in Kraft tritt, schreibt die Offenlegung synthetischer Darsteller in Werbeanzeigen vor, mit Bußgeldern ab 1.000 Dollar. Illinois hat ebenfalls Regelungen eingeführt, die sich auf die Verhinderung täuschender Deepfakes während Wahlen und in bestimmten Kontexten wie Einstellungsverfahren konzentrieren.

Wie beeinflussen Deepfakes das Wählervertrauen in Wahlen ?

KI-Deepfakes werfen erhebliche Bedenken hinsichtlich der Täuschung von Wählern auf, insbesondere in hart umkämpften Rennen. Bei Marylands Wahlen 2026 warnten Experten, dass gefälschte Videos das Wählerverhalten beeinflussen könnten, bevor Faktenchecker oder Plattformen Zeit haben, sie zu überprüfen und zu entfernen. Bei den Vorwahlen zu den Zwischenwahlen wurde ein Anstieg potenziell KI-generierter Wahlkampfwerbespots verzeichnet. Sie und Wahlexperten gleichermaßen befürchten, dass die sich schnell entwickelnde Deepfake-Technologie die Wahrnehmung von Kandidaten verändert und es zunehmend schwieriger macht, videobasiertem politischen Inhalt ohne unabhängige Überprüfung zu vertrauen.

Welche Rolle spielen Social-Media-Plattformen bei der Regulierung politischer KI-Inhalte ?

Social-Media-Plattformen tragen nun erhebliche regulatorische Verantwortung im Rahmen staatlicher Gesetze, die KI-generierte politische Inhalte regeln. Große Plattformen sind verpflichtet, fortschrittliche Erkennungstechnologien einzusetzen, um täuschende synthetische Medien während Wahlzyklen zu identifizieren. Sie müssen gemeldete Inhalte innerhalb gesetzlich festgelegter Fristen entfernen, wie etwa Californias 72-Stunden-Entfernungsfenster. Plattformen, die die Vorschriften nicht einhalten, sehen sich Durchsetzungsmaßnahmen gegenüber, darunter einstweilige Verfügungen, die von betroffenen Kandidaten oder Amtsträgern beantragt werden, sowie rechtliche Verfolgungen, die von staatlichen Generalstaatsanwälten und lokalen Staatsanwälten eingeleitet werden.

Hat der Kongress Maßnahmen zur Regulierung von KI in politischer Werbung ergriffen ?

Stand 2026 hatte weder der Kongress noch die Bundeswahlkommission Regeln erlassen, die speziell den Einsatz von KI in politischer Werbung auf Bundesebene regeln. Dieses Fehlen einer Bundesregulierung schafft ein ungleichmäßiges rechtliches Terrain, in dem Sie bei Senatswahlen und Bundeswahlen erheblich weniger Schutz genießen als bei Wahlen auf Staatsebene. Die regulatorische Last ist auf einzelne Bundesstaaten gefallen, was zu inkonsistenten Regeln führt, die je nach geografischer Lage und Art des Wahlrennens stark variieren.

Wie nutzen politische Wahlkampagnen KI in Angriffswerbung ?

Politische Kandidaten nutzen zunehmend KI-Werkzeuge, um scharf zielgerichtete und potenziell irreführende Angriffswerbung gegen ihre Gegner zu erstellen. Ein bemerkenswertes Beispiel betraf die Wahlkampagne von Mike Collins für den Senat, die ein KI-generiertes Video verwendete, das Senator John Oaf fälschlicherweise dabei zeigte, wie er behauptete, für die Fortführung des Regierungsstillstands gestimmt zu haben. In Texas U.S.-Senatswahlen haben KI-generierte Videos öffentliche Personen dazu gebracht, scheinbar Aussagen zu machen, die sie nie tatsächlich gemacht haben. Diese Taktiken nutzen das Fehlen bundesweiter Beschränkungen für KI-Wahlkampfinhalte aus und werfen ernsthafte ethische und rechtliche Fragen auf.

Welche Strafen gibt es für Verstöße gegen Gesetze zur politischen Deepfake-Werbung ?

Die Strafen für Verstöße gegen deepfake-bezogene Gesetze zur politischen Werbung variieren je nach Bundesstaat. Im Rahmen von New Yorks Gesetz zur Offenlegung synthetischer Medien beginnen die Bußgelder bei 1.000 Dollar pro Verstoß für das Versäumnis, die Verwendung KI-generierter Darsteller in Werbeanzeigen offenzulegen. Californias Rahmen erlaubt es Kandidaten und gewählten Amtsträgern, einstweilige Verfügungen gegen nicht konforme Plattformen zu beantragen, während der Generalstaatsanwalt des Staates und Staatsanwälte weitergehende rechtliche Schritte einleiten können. Texas konzentriert die Durchsetzung auf das Verbot täuschender Deepfake-politischer Werbung in der Nähe von Staatswahlen, obwohl Strafen speziell für Bundeswahlen nach geltendem Recht weitgehend fehlen.

Abschließende politische Implikationen

Die Regeln rund um Künstliche Intelligenz ändern sich schnell, und Unternehmen, Gesetzgeber und Einzelpersonen versuchen alle, Schritt zu halten. Es ist nicht einfach, die richtige regulatorische Balance zwischen Sicherheit und Freiheit zu finden – aber es ist notwendig.

Was bedeuten diese politischen Herausforderungen für Sie ?

- Bleiben Sie über die Gesetze in den Bundesstaaten informiert, in denen Sie leben oder tätig sind – sie variieren stark.

- Erwarten Sie Reibungen zwischen Bundes- und Landesvorschriften, bis Gerichte diese Debatte beilegen.

- Schützen Sie sich, indem Sie Ihre Rechte bei KI-gesteuerten Entscheidungen wie Krediten oder Einstellungen verstehen.

- Fordern Sie Transparenz von Marken ein, die KI einsetzen, die Ihr tägliches Leben beeinflusst.

Sie verdienen sowohl Innovation als auch Schutz. Das Ziel ist nicht, den Fortschritt zu verlangsamen – sondern sicherzustellen, dass der Fortschritt für alle funktioniert, nicht nur für eine ausgewählte Gruppe. Eine Koalition von 42 Generalstaatsanwälten hat verstärkte Durchsetzungsmaßnahmen angekündigt, die sich sowohl gegen KI-Entwickler als auch gegen Unternehmen richten, die KI-Tools einsetzen.

Quellenangabe

- https://www.gunder.com/en/news-insights/insights/2026-ai-laws-update-key-regulations-and-practical-guidance

- https://www.kiteworks.com/cybersecurity-risk-management/ai-regulation-2026-business-compliance-guide/

- https://www.cimplifi.com/resources/the-ai-regulation-landscape-for-2026-what-legal-and-compliance-leaders-need-to-know/

- https://www.bestlawyers.com/article/how-2026-will-reshape-technology-and-ai-law/7365

- https://www.softwareimprovementgroup.com/blog/us-ai-legislation-overview/

- https://www.whitehouse.gov/wp-content/uploads/2026/03/03.20.26-National-Policy-Framework-for-Artificial-Intelligence-Legislative-Recommendations.pdf

- https://www.wsgr.com/en/insights/2026-year-in-preview-ai-regulatory-developments-for-companies-to-watch-out-for.html

- https://mofotech.mofo.com/topics/ai-trends-for-2026—how-states-will-shape-ai-enforcement

- https://ppc.land/california-adds-new-rules-to-combat-ai-deepfakes-in-elections/

- https://www.youtube.com/watch?v=mEzXfHvkQk4