KI Energieverbrauch steigt – Umweltfolgen wachsen

29/03/2026

Neue Voice KI wird immer menschlicher

29/03/2026Asus signalisiert eine massive Expansion seines Geschäftsbereichs für künstliche Intelligenz-Server bis 2026. Das Unternehmen plant, dieses Geschäftssegment innerhalb der nächsten zwei Jahre zu verdoppeln. Sie werden beobachten, dass die Serververkäufe kürzlich 22 Prozent des vierteljährlichen Umsatzes von Asus erreicht haben. Diese Entwicklung zeigt ein erhebliches Momentum auf dem Markt.

Asus verfolgt diese Expansion durch strategische Partnerschaften und innovative technische Ansätze. Diese Faktoren ermöglichen es dem Unternehmen, seine Position auf dem wachsenden Markt für künstliche Intelligenz-Infrastruktur zu stärken. Sie könnten fragen, was Asus von seinen Wettbewerbern in diesem Sektor unterscheidet.

Das Unternehmen konzentriert sich auf spezifische technologische Vorteile. Asus nutzt seine Expertise in Hardwaredesign und Fertigungseffizienz. Sie werden feststellen, dass diese Kompetenzen eine Grundlage für nachhaltiges Wachstum in der Produktion von künstliche Intelligenz-Servern schaffen.

Asus erkennt die globale Nachfrage nach künstliche Intelligenz-Infrastruktur an. Sie benötigen zuverlässige Serverlösungen, die höchste technische Standards erfüllen. Das Unternehmen begegnet dieser Notwendigkeit durch gezielte Produktentwicklung und strategische Marktpositionierung.

Die Expansion spiegelt breitere Trends in der Technologieindustrie wider. Organisationen weltweit investieren erheblich in künstliche Intelligenz-Infrastruktur. Sie profitieren vom erhöhten Wettbewerb und der Innovation in diesem Marktsegment. Asus positioniert sich durch seine Expansionsstrategie, um einen bedeutenden Anteil dieser wachsenden Nachfrage zu erfassen.

Der Ansatz des Unternehmens kombiniert operative Exzellenz mit Marktbewusstsein. Sie können kontinuierliche Entwicklungen bei den Angeboten von Asus im Bereich künstliche Intelligenz-Server bis 2026 und darüber hinaus erwarten.

ASUS baut seine Infrastructure Solutions Business Group aus, um eine stärkere Präsenz in der Künstlichen-Intelligenz-Technologie zu etablieren. Sie werden feststellen, dass das Unternehmen umfassende Systeme entwickelt, um Ihr Unternehmen in die Lage zu versetzen, KI-Technologie effektiv zu nutzen. Diese Systeme bilden die wesentliche Grundlage, die gewährleistet, dass KI zuverlässig in allen Umgebungen funktioniert , von großen Rechenzentren bis zu kompakten Edge-Geräten.

ASUS hat sich ein ehrgeiziges Wachstumsziel für 2026 gesetzt. Das Unternehmen plant, sein KI-Server-Geschäft innerhalb eines Jahres zu verdoppeln. Der Server-Umsatz erreichte im vierten Quartal 2025 22 Prozent des Gesamtverkaufs, verglichen mit 18 Prozent für das gesamte Jahr. Diese Entwicklung demonstriert die derzeit in diesem Marktsegment vorhandene Dynamik.

ASUS etabliert strategische Partnerschaften, um diese Expansion zu erreichen. Das Unternehmen arbeitet mit NVIDIA und IBM zusammen, um eine „AI Refinery” zu entwickeln , ein vollständiges System, das es Ihrem Unternehmen ermöglicht, leistungsstarke KI-Tools sicher bereitzustellen. Jeder Partner trägt seine Kernkompetenz bei : ASUS stellt die Recheninfrastruktur bereit, NVIDIA liefert die Künstliche-Intelligenz-Verarbeitungsfähigkeiten, und IBM verwaltet die Datenspeicherung. Diese Partnerschaft ermöglicht es Ihrem Unternehmen, KI in allen operativen Bereichen einzusetzen. Die konvergente Architektur integriert von NVIDIA zertifizierte Speicheranbieter, um robuste und optimierte Leistung in allen Bereitstellungen sicherzustellen.

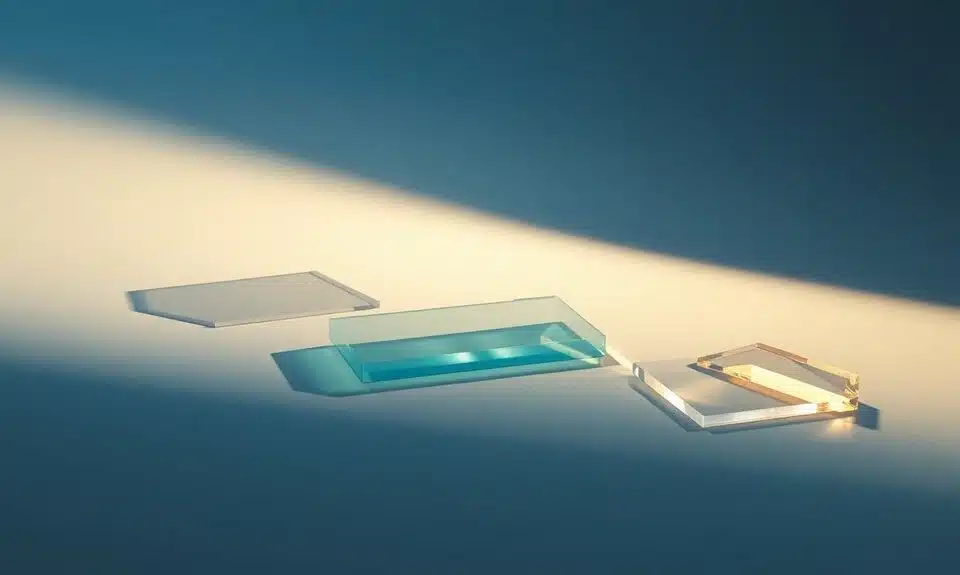

Kühlungstechnologie stellt eine weitere zentrale Komponente dieser Strategie dar. Der neue ASUS AI POD enthält fortschrittliche Kühlungslösungen, die optimale Systemleistung aufrechterhalten. Sie können je nach Ihren spezifischen Anforderungen zwischen Flüssigkühlung, Hybrid-Kühlung oder herkömmlicher Luftkühlung wählen. Diese Flexibilität ermöglicht es Ihrem Unternehmen, den Energieverbrauch und die Betriebskosten zu senken, während anspruchsvolle KI-Systeme betrieben werden. Ausgewählte Systeme können einen Stromverbrauch von bis zu 227 Kilowatt bewältigen.

ASUS entwickelt auch Edge-Lösungen für verteilte Standorte außerhalb zentralisierter Rechenzentren. Das ET900N Expert Center ist für Edge-KI-Anwendungen konzipiert. Die Ascent GX10-Plattform unterstützt Robotik und Bereitstellung autonomer Fahrzeuge. Das PE 3000N, ausgestattet mit NVIDIA-Technologie, bringt fortschrittliche KI-Funktionen an die Orte, an denen Sie sie am meisten benötigen.

ASUS nutzt Größenvorteile als Wettbewerbsvorteil. Höhere Produktionsvolumen führen zu verbesserter Lieferantenpreisgestaltung. Dieser Vorteil stärkt die finanzielle Leistung des Unternehmens und ermöglicht es Ihnen, wettbewerbsfähige Preise zu erhalten. Die gesamte Lieferkette profitiert von diesem Ansatz.

Die Infrastructure Business Group hat sich von einem anfänglichen Pilotprogramm zu einem wesentlichen Einnahmestrom für ASUS entwickelt. Bis 2026 könnte dieses Geschäftssegment zur umsatzstärksten Abteilung von ASUS werden. Der Markt zeigt klare Nachfrage nach KI-Infrastrukturlösungen, und ASUS ist gut positioniert, um diese Nachfrage effektiv zu erfüllen.

AI-Server : Fortgeschrittene Computersysteme für komplexe KI-Workloads

AI-Server sind fortgeschrittene Computersysteme, die Sie speziell für die Bewältigung komplexer, ressourcenintensiver KI-Workloads entwickeln. Anders als traditionelle Server, die Sie nur mit CPUs, RAM, Netzwerk und Speicher betreiben, integrieren AI-Server spezialisierte Hardware wie GPUs, TPUs und FPGAs, um Parallelverarbeitung zu ermöglichen. Diese spezialisierte Architektur ermöglicht es Ihnen, Machine-Learning-Training, Deep-Learning-Modelle, massive Datensätze und Echtzeit-Analysen in einem Umfang zu unterstützen, den herkömmliche Server nicht erreichen können.

Warum sind GPUs in AI-Server-Konfigurationen unverzichtbar ?

GPUs sind kritische Komponenten, die Sie zur Beschleunigung der Parallelverarbeitung für Machine-Learning-Training, Deep Learning, Computer Vision und generative KI-Anwendungen einbauen müssen. Sie führen mehrere Berechnungen gleichzeitig durch, was Ihr Model-Training im Vergleich zu CPU-only-Systemen erheblich beschleunigt. Ihre Fähigkeit, Tausende von Threads gleichzeitig zu verarbeiten, macht sie ideal für die Matrixoperationen und Tensorberechnungen, die für Ihre KI-Workloads grundlegend sind. Daher finden Sie mehrere GPUs in den meisten modernen AI-Servern.

Welche spezialisierten Beschleuniger sind für AI-Server verfügbar ?

Sie können verschiedene spezialisierte Beschleuniger in AI-Server integrieren, die über GPUs hinausgehen. Diese umfassen TPUs, die für Tensorberechnungen optimiert sind, FPGAs, die benutzerdefinierte rekonfigurierbare Berechnungen ermöglichen, und ASICs, die speziell für bestimmte KI-Aufgaben entwickelt wurden. Führende Beispiele, die Sie in Betracht ziehen sollten, sind NVIDIAs L4 Tensor Core und H100 GPUs sowie AMDs Instinct-Serie. Jeder Beschleunigertyp bietet unterschiedliche Leistungsmerkmale, die auf Ihre spezifischen Workloads zugeschnitten sind, vom Training großer Sprachmodelle bis zur Produktionsinferenz.

Wie viel Speicher benötigen AI-Server normalerweise ?

Sie müssen erheblich mehr Speicher in AI-Servern bereitstellen als in traditionellen Servern, um massive Datensätze und komplexe Berechnungen zu verarbeiten. Hochbandbreitenspeicher (HBM) und große RAM-Kapazitäten sind wesentliche Komponenten, die Sie einbeziehen müssen. Die spezifischen Speicheranforderungen hängen von Ihrer Workload ab. Das Training großer Sprachmodelle erfordert erheblich mehr Speicher als Edge-KI-Anwendungen oder Inferenzaufgaben, die Sie mit kleineren Konfigurationen erfüllen können.

Welche Rolle spielt Netzwerk in der AI-Server-Infrastruktur ?

Sie müssen Hochgeschwindigkeitsnetzwerk mit fortschrittlichen Netzwerkschnittstellenkarten (NICs) sicherstellen, um die Datenbewegung zwischen Ihren Speichersystemen und Recheneinheiten mit niedriger Latenz zu ermöglichen. Dies ist besonders wichtig für verteilte Trainingsszenarien, in denen Sie die Kommunikation zwischen mehreren Servern effizient koordinieren müssen. Schnelle Netzinfrastruktur verhindert Engpässe und ermöglicht es Ihnen, nahtlos über mehrere Knoten zu skalieren. Diese Skalierung ist für Sie essentiell, um massive Datensätze zu verarbeiten und parallele Berechnungen über Ihre Servercluster zu koordinieren.

Wie sollten Sie AI-Server für Training versus Inferenz-Workloads unterschiedlich konfigurieren ?

Sie sollten Trainingskonfigurationen mit mehreren leistungsstarken GPUs und umfangreichem Speicher entwerfen, um komplexe Modelloptimierung zu bewältigen. Eine häufige generative KI-Konfiguration, die Sie möglicherweise bereitstellen, nutzt zwei CPUs gekoppelt mit acht GPUs. Sie sollten Inferenzkonfigurationen anders gestalten und dabei den Durchsatz priorisieren und häufig spezialisierte Beschleuniger verwenden. Sie betreiben typischerweise Produktionsinferenzserver als GPU-Cluster, die Tausende gleichzeitiger Anfragen durch Inferenz-Engines wie TensorRT oder vLLM verarbeiten, die Sie auf niedrigere Latenz und Kosteneffizienz optimieren.

Welche Speicherlösungen sind am besten für AI-Server ?

Sie sollten NVMe-Speicher als bevorzugte Lösung für AI-Server auswählen, da er den schnellen Zugriff bietet, den Sie für großflächige Datenverarbeitung benötigen. Hochgeschwindigkeitsspeicher verhindert I/O‑Engpässe beim Laden massiver Datensätze zum Training oder für Inferenz. Die spezifische Speicherkapazität, die Sie benötigen, hängt von Ihrer Datensatzgröße und Workload-Anforderungen ab. However, NVMes überlegene Geschwindigkeit gegenüber traditionellen Festplatten macht es für Sie unverzichtbar, die Leistung in anspruchsvollen KI-Anwendungen aufrechtzuerhalten.

Wie funktioniert Skalierbarkeit in AI-Server-Architekturen ?

Sie können modulare Designs in AI-Servern einsetzen, die es Ihnen ermöglichen, horizontal und vertikal zu skalieren, um Ihre schwankenden Workloads zu bewältigen. Sie können zusätzliche GPUs, KI-Beschleuniger und Überwachungskarten hinzufügen, wenn Ihre Anforderungen wachsen. Skalierbare Architekturen ermöglichen es Ihnen, mit Basiskonfigurationen zu beginnen und Ihre Rechenkapazität, Speicher und Speicherplatz schrittweise zu erweitern. Dieser Ansatz gewährleistet Kosteneffektivität, während Sie die Leistung mit steigenden KI-Workload-Anforderungen aufrechterhalten.

Welche Branchen profitieren am meisten von AI-Server-Bereitstellungen ?

Sie finden AI-Server-Bereitstellungen in verschiedensten Branchen, einschließlich Finanzen, wo Sie sie für algorithmischen Handel und Risikoanalyse einsetzen ; Kundenservice, wo Sie sie für Chatbots und Automatisierung bereitstellen ; Cybersicherheit, wo Sie sie für Bedrohungserkennung einsetzen ; Fertigung, wo Sie sie für vorausschauende Wartung anwenden ; und Gesundheitswesen, wo Sie sie für diagnostische Bildgebung und Wirkstoffforschung nutzen. Jeder Sektor nutzt die spezialisierte Rechenleistung von AI-Servern, um komplexe Algorithmen zu verarbeiten, massive Datensätze zu analysieren und Echtzeit-Analysen zu generieren, die Sie für Ihre Betriebe benötigen.

Welche zusätzlichen Infrastrukturkomponenten ergänzen AI-Server ?

Sie sollten anerkennen, dass umfassende KI-Infrastruktur über einzelne Server hinausgeht und Rechenschichten, Speicherarchitektur, Netzwerkfabric und Rechenzentrum-Grundlagen umfasst. Sie müssen Stromversorgungseinheiten bereitstellen, die energieeffiziente 24/7‑Betrieb unterstützen, da diese für Ihre Bereitstellung kritisch sind. Sie benötigen auch Verwaltungstools, die Sie zur Optimierung von Leistung und Wartung nutzen können. Dieses umfassende Ökosystem stellt sicher, dass Ihre AI-Server zuverlässig funktionieren, während Sie nachhaltige Leistung für Ihre unternehmensweiten Bereitstellungen erreichen.

AI-Infrastrukturmarkt beschleunigt sein Wachstum

Der globale Markt für Computersysteme, die künstliche Intelligenz antreiben, erlebt signifikantes Wachstum. Von 2025 bis 2030 werden Sie beobachten, dass sich dieser Sektor fast verdreifacht, expandierend von 158,3 Milliarden Dollar auf 418,8 Milliarden Dollar. Dies repräsentiert erhebliche Kapitalinvestitionen in die Technologieinfrastruktur, die künstliche Intelligenz möglich macht.

Mehrere Faktoren treiben diese Marktexpansion an. Sie benötigen leistungsfähigere Computersysteme, um wachsende Anforderungen der künstlichen Intelligenz zu erfüllen. Edge Computing ermöglicht es Ihnen, künstliche Intelligenz-Anwendungen näher an Ihren Datenquellen zu verarbeiten, was zu verbesserter Systemleistung und reduzierter Latenz führt. Energieeffizienz stellt eine weitere kritische Überlegung dar, da Rechenzentren erhebliche Mengen an elektrischer Energie verbrauchen. Beschleunigte Server werden bis 2029 95 Prozent der Server-KI-Infrastrukturausgaben übersteigen, was ihre kritische Rolle bei der Erfüllung von Rechenanforderungen unterstreicht.

Die Marktdaten demonstrieren klare Expansionstrends. Jährliche Wachstumsraten erreichen 21,5 Prozent weltweit, während bestimmte Regionen höhere Expansionsraten erzielen. China zum Beispiel verzeichnet Wachstumsraten von 41,5 Prozent jährlich. Nordamerika behält den größten Anteil der Marktinvestitionen, das 44,7 Prozent der gesamten globalen Expansion ausmacht.

Diese Beschleunigung spiegelt echte Geschäftsanforderungen wider. Sie erkennen künstliche Intelligenz-Infrastruktur als wesentlich für Ihre operative Strategie, nicht als optionale Investition. Ihre Organisationen verpflichten Ressourcen, um sicherzustellen, dass Sie über die erforderliche Rechenkapazität verfügen, um künstliche Intelligenz-Anwendungen und ‑Dienste zu unterstützen.

Quellenangabe

- https://press.asus.com/blog/enterprise-ai-insights-gtc-2026-asus

- https://www.youtube.com/watch?v=Aa2nCGY7EIw

- https://www.asus.com/us/business/blog/asus-business-summit-2026-highlights/

- https://www.engineering.com/asus-introduces-liquid-cooled-ai-infrastructure-at-gtc-2026/

- https://finance.biggo.com/news/65–515wBh5an-7GhARYD

- https://www.asus.com/us/news/geklss9pl2hu7tza/

- https://futurumgroup.com/insights/asustek-q4-fy-2025-results-highlight-server-mix-shift-and-ai-led-portfolio-expansion/

- https://www.asus.com/business/resources/news/asus-ai-powered-portfolio-ces-2026/

- https://www.networkworld.com/article/3835113/what-is-an-ai-server-why-artificial-intelligence-needs-specialized-systems.html

- https://www.lenovo.com/us/en/glossary/ai-server-hardware-components/