Elon Musks Xai expandiert massiv

01/01/2026

Neues Gesetz zwingt Tech-Giganten zur Offenlegung von KI-Risikoplänen

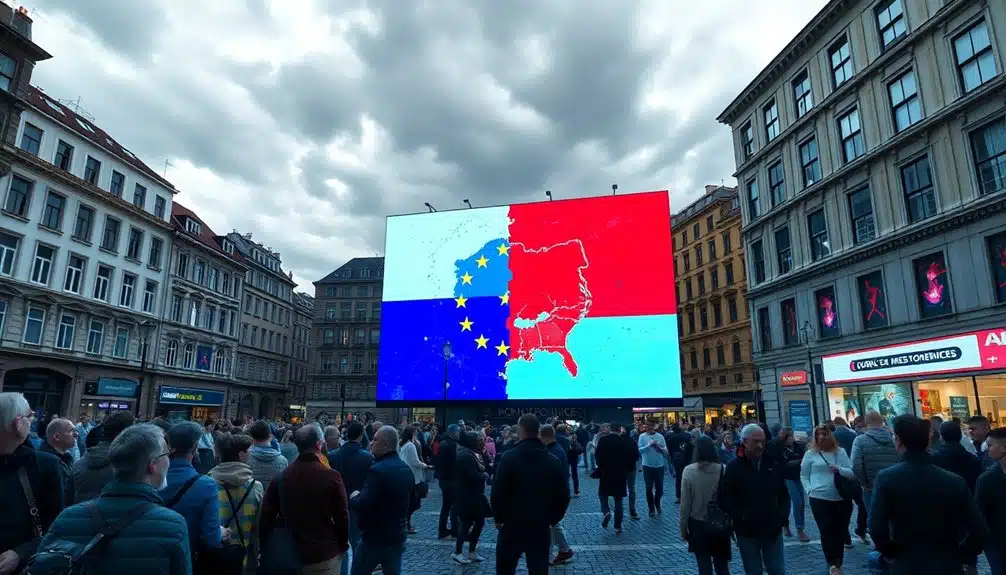

01/01/2026In ganz Polen tauchen gefälschte Videos auf TikTok auf mit einer klaren Botschaft : die Europäische Union verlassen. Diese Clips zeigen jedoch keine echten Personen. Sie werden von künstlicher Intelligenz erstellt und sind darauf ausgelegt, authentisch auszusehen und zu klingen. Junge Zuschauer scrollen täglich an ihnen vorbei, oft ohne zu wissen, dass sie computergenerierte Inhalte betrachten. EU-Beamte sind aufmerksam geworden und schlagen Alarm darüber, wer hinter diesen Kampagnen steckt und warum sie auf die nächste Generation von Wählern des Landes abzielen. Die Frage ist nun, ob die aktuellen Schutzmaßnahmen diese digitale Manipulation stoppen können, bevor sie die öffentliche Meinung umformt.

Die TikTok-Desinformationskampagne gegen polnische Jugendliche

Wie führten Videos von jungen Frauen in polnischen Flaggen-Shirts zu einer internationalen Untersuchung ? Polens Regierung entdeckte ein beunruhigendes Muster auf TikTok. Der Account “Prawilne Polki” teilte KI-erstellte Inhalte, die Polen dazu aufriefen, die Europäische Union zu verlassen. Das waren keine echten Personen, die ihre Meinung äußerten. Es waren synthetische Videos mit Desinformationstaktiken, die darauf ausgelegt waren, Meinungen zu manipulieren.

Die Kampagne zielte speziell auf polnische Jugendliche mit patriotischen Bildern und emotionalen Appellen ab. Junge Zuschauer sahen Frauen in flaggen-thematischer Kleidung, die behaupteten, Polen fühlte sich “polnischer” vor dem EU-Beitritt. Die Botschaft befürwortete “Wahlfreiheit”, während sie Polexit-Narrative vorantrieb.

Polnische Beamte identifizierten russische Syntax in den Aufnahmen, was ausländische Einmischung aufdeckte. Diese koordinierte Anstrengung nutzte Jugend-Engagement-Strategien aus und ließ gefährliche Propaganda authentisch und nachvollziehbar für jüngere Zielgruppen in ganz Polen erscheinen. Polens Ministerium für Digitale Angelegenheiten ersuchte die Europäische Kommission offiziell darum, TikTok wegen Verstößen gegen das Gesetz über digitale Dienste zu untersuchen.

Wie KI-generierte Personas Pro-Polexit-Botschaften verbreiten

Die Videos zeigten junge, attraktive Frauen, die direkt zu den Zuschauern über das Verlassen der Europäischen Union sprachen, sorgfältig gestaltet, um eine Verbindung zu Teenagern und jungen Erwachsenen herzustellen, die durch TikTok scrollen. Diese KI-erstellten Charaktere waren keine echten Personen, aber sie lieferten nationalistische Gesprächsthemen in einem Format, das sich persönlich und nachvollziehbar für ihre Zielgruppe anfühlte. Die Kampagne stützte sich auf emotionale Appelle statt auf Fakten und verwendete kurze Clips, die darauf optimiert waren, Aufmerksamkeit zu erregen und starke Gefühle über polnische Identität und Unabhängigkeit auszulösen. Das Konto erreichte 200.000 Impressionen und fast 20.000 Likes innerhalb von nur zwei Wochen gezielter Botschaften.

Fiktive Frauen zielen auf Jugendliche ab

Seit Mai 2023 veröffentlicht ein TikTok-Kanal namens “Prawilne_Polki” Videos mit schönen jungen Frauen, die leidenschaftlich über Polens Austritt aus der Europäischen Union sprechen. Diese Frauen existieren tatsächlich nicht. Jedes Video zeigt eine andere KI-generierte Persona, die darauf ausgelegt ist, attraktiv auszusehen und überzeugend zu klingen.

Der Kanal richtet sich gezielt an Zielgruppen im Alter von 15 bis 25 Jahren—zukünftige Wähler, die Polens Richtung prägen werden. Diese virtuelle Identitätsstrategie zielt darauf ab, das Jugendengagement bei kritischen politischen Fragen zu beeinflussen. Die fiktiven Frauen erscheinen eloquent und patriotisch und stellen in Frage, ob Polen nach zwanzig Jahren Mitgliedschaft in der EU verbleiben sollte.

Zusammen haben diese Videos fast 200.000 Aufrufe erreicht und über 20.000 Likes erhalten. Die Botschaften verbreiten sich leicht unter jungen Zuschauern, die möglicherweise nicht erkennen, dass sie künstliche Inhalte ansehen, die darauf ausgelegt sind, ihr politisches Denken zu formen. Die Videos referenzieren oft Nationalismus und kritisieren Migrationspolitiken neben Angriffen auf die aktuelle polnische Regierung.

Strategische Emotionale Manipulationstaktiken

Warum wirken diese KI-generierten Frauen auf junge polnische Zuschauer so überzeugend ? Die Antwort liegt in sorgfältig gestalteter emotionaler Ansprache, die darauf ausgelegt ist, rationales Denken zu umgehen. Diese digitalen Persönlichkeiten stützen sich nicht auf Fakten oder Daten. Stattdessen lösen sie Gefühle bezüglich nationaler Identität, kultureller Bedrohungen und Zugehörigkeit aus. Die Videos greifen Ängste über Migration und das Verschwinden polnischer Traditionen auf. Diese digitale Manipulation zielt zuerst auf Emotionen ab, Denken kommt an zweiter Stelle.

| Manipulationselement | Zielemotion | Beabsichtigte Wirkung |

|---|---|---|

| Nationalistische Botschaften | Stolz und Zugehörigkeit | Schafft “Wir gegen sie”-Mentalität |

| Migrationskritik | Furcht und Angst | Stellt EU als kulturelle Bedrohung dar |

| Identitätsfragen | Unsicherheit und Zweifel | Untergräbt Vertrauen in aktuelle Politik |

Die Kampagne zielt speziell auf 15- bis 25-Jährige ab, die noch keine starken politischen Ansichten entwickelt haben. Junge Köpfe werden zum fruchtbaren Boden für überzeugende Botschaften, die in nachvollziehbare, personenbezogene Inhalte verpackt sind. Europäische Regulierungsbehörden prüfen zunehmend, wie große Tech-Plattformen unfaire Bedingungen für Inhaltsersteller und Verlage in digitalen Märkten durchsetzen.

EU-KI-Gesetz-Anforderungen für Inhaltstransparenz

Unter Europas neuem KI-Gesetz muss jeder, der Videos mit künstlicher Intelligenz erstellt, strenge Regeln befolgen, um die Zuschauer darüber zu informieren, was sie sich ansehen. Das Gesetz besagt, dass Ersteller synthetische Inhalte auf zwei Arten kennzeichnen müssen : mit klaren Markierungen, die Einzelpersonen sehen können, und mit versteckten digitalen Tags, die Computer lesen können. Diese Anforderungen treten im August 2026 in Kraft, was bedeutet, dass die Ersteller hinter jenen Pro-Polexit-Videos bald ernsthafte Fragen darüber bekommen könnten, ob sie sich an Europas Transparenzregeln halten. Das KI-Gesetz etabliert einen klaren rechtlichen Rahmen für KI-Vorschriften ohne Schonfrist für die Einhaltung und setzt Content-Ersteller sofort unter Druck, ihre Verpflichtungen zu verstehen.

Verpflichtende KI-Offenlegungsregeln

Die Europäische Union verlangt, dass Unternehmen Verbrauchern mitteilen, wann sie mit einer Maschine sprechen oder KI-erstellte Inhalte betrachten. Diese Offenlegungspflicht schützt das Bewusstsein der Nutzer, bevor eine Interaktion beginnt. Unternehmen müssen Personen bei der ersten Kontaktaufnahme klar benachrichtigen, es sei denn, die KI-Beteiligung ist bereits offensichtlich.

Die Regeln umfassen alle synthetischen Medien—Videos, Bilder, Audio und Text. Unternehmen müssen KI-generierte Inhalte so kennzeichnen, dass Computer sie lesen und Nutzer sie erkennen können. Dies hilft, Täuschung zu verhindern und stoppt die unkontrollierte Verbreitung falscher Informationen. Organisationen müssen maschinenlesbare Kennzeichnung für alle synthetischen Inhalte bereitstellen, um die regulatorische Compliance sicherzustellen.

Deepfakes erfordern spezielle Offenlegung. Jeder, der manipulierte Medien veröffentlicht, muss deren künstlichen Ursprung offenlegen. Einige Ausnahmen bestehen für autorisierte Strafverfolgungsaktivitäten und kreative Projekte. Inhalte, die öffentliche Angelegenheiten behandeln, verlangen jedoch Transparenz. Wenn Personen Nachrichten und Informationen konsumieren, verdienen sie zu wissen, ob ein Mensch oder ein Algorithmus das erstellt hat, was sie sehen.

Standards für maschinenlesbare Transparenz

Die bloße Offenlegung löst das Transparenzrätsel nicht. Die EU verlangt etwas Tieferes : maschinenlesbare Formate, die sowohl Menschen als auch Computer überprüfen können. Dieses technische Rückgrat stärkt die KI-Rechenschaftspflicht über Grenzen hinweg und stellt sicher, dass synthetische Inhalte digitale Fingerabdrücke tragen, die zu ihrer Quelle zurückverfolgt werden können.

Die Verordnung schreibt drei Kernelemente vor :

- Eingebettete Markierungen in Audio‑, Video‑, Bild- und Textausgaben

- Standardisierte Erkennungsmethoden, die in der gesamten Vertriebskette zugänglich sind

- Detaillierte Dokumentation, die Entwicklungsprozesse und Trainingsdaten verfolgt

Diese Anforderungen gelten sowohl für Anbieter als auch für Deployer und schaffen ein Verifizierungsnetzwerk, das automatisch funktioniert. Wenn KI-generierte polnische Exit-Videos online zirkulieren, ermöglichen diese unsichtbaren Tags Behörden und Bürgern, Manipulation schnell zu identifizieren. Das System schützt die individuelle Wahlfreiheit, indem es künstliche Inhalte ohne ständige menschliche Überwachung identifizierbar macht. Das AI Office wird die Erstellung von Verhaltenskodizes erleichtern, um die Erkennung und Kennzeichnung künstlicher Inhalte zu verbessern.

Plattform-Erkennungsfehler und algorithmische Verstärkung

Künstliche Intelligenz-Detektoren haben Schwierigkeiten, mit der Flut von gefälschten Videos Schritt zu halten, die sich über soziale Medienplattformen ausbreiten. Tests zeigen beunruhigende Plattform-Schwachstellen, da Erkennungstools KI-generierte Clips in alarmierendem Maße übersehen. Im Februar 2024 fanden Forscher heraus, dass selbst Top-Detektoren 20–30% an Genauigkeit verloren, wenn sie synthetische Videos von beliebten Generatoren analysierten.

Die Erkennung von Fehlinformationen wird schwieriger, wenn Algorithmen falsche Inhalte verbessern, bevor sie jemand entdeckt. Während der Proteste in Los Angeles kaperten gefälschte Nationalgarde-Videos innerhalb von Stunden Gespräche. Pro-russische Accounts verwandelten ein manipuliertes Bild in virale Memes in der Ukraine. Die Geschwindigkeit des Teilens übertrifft jedes Mal die Verifizierungsbemühungen.

Plattformen verlassen sich auf veraltete Systeme, die Videos wie Fotosequenzen behandeln und dabei wichtige Hinweise übersehen. Manuelle Faktenprüfung füllt Lücken, kann aber nicht mit algorithmischen Fördergeschwindigkeiten mithalten. Diese technologische Lücke macht Gemeinschaften anfällig für koordinierte Täuschungskampagnen. KI-Erkennungstools, die auf bereinigten Daten trainiert wurden, versagen oft, wenn sie mit den unordentlichen Realitäten mehrsprachiger Inhalte und nicht-englischsprachiger Kontexte konfrontiert werden.

Googles Kartellrechtsuntersuchung wegen KI-Trainingsdaten

Europäische Regulierungsbehörden richteten diese Woche ihr Augenmerk auf Google und leiteten eine formelle Untersuchung darüber ein, wie der Tech-Riese die Arbeiten anderer Personen nutzt, um seine künstlichen Intelligenz-Systeme zu trainieren. Die Untersuchung prüft, ob Googles Dominanz bei Such- und Videoplattformen unfaire Vorteile im KI-Rennen schafft.

EU-Vorschriften ermächtigen Beamte, potenzielle Missbräuche unter dem Wettbewerbsrecht anzufechten. Die Untersuchung konzentriert sich auf drei Hauptbedenken :

- Verleger verlieren Traffic, wenn sie das KI-Content-Scraping ablehnen

- YouTube-Ersteller werden gezwungen, KI-Trainingsrechte ohne Bezahlung zu gewähren

- Konkurrierende KI-Entwickler werden daran gehindert, auf YouTubes massiven Datenschatz zuzugreifen

Teresa Ribera, die die Wettbewerbsdurchsetzung leitet, betonte den Schutz der Medienvielfalt und fairer Märkte. Verleger und Ersteller stehen derzeit vor einer schwierigen Wahl : Googles Bedingungen akzeptieren oder riskieren, vollständig aus den Suchergebnissen zu verschwinden.

Die untersuchten Praktiken könnten gegen Artikel 102 des EU-Vertrags verstoßen, der den Missbrauch einer dominanten Marktposition verbietet.

Regulatorische Durchsetzung und der Verhaltenskodex

Transparenz wird zum Grundstein eines neuen Rahmens, der Einzelpersonen dabei helfen soll, von Maschinen erstellte Inhalte zu erkennen. Der Verhaltenskodex der Europäischen Union geht regulatorische Herausforderungen direkt an und gibt Anbietern und Anwendern klare Wege vor. Ab August 2026 müssen Unternehmen KI-Ausgaben in maschinenlesbaren Formaten kennzeichnen und gleichzeitig Erkennungssysteme auch nach dem Verlassen des Marktes aufrechterhalten.

Compliance-Strategien betonen Zusammenarbeit statt starrer Regeln. Anbieter benötigen robuste Kennzeichnungssysteme, während Anwender Deepfakes und KI-generierte Inhalte von öffentlichem Interesse kennzeichnen müssen. Das Europäische KI-Amt koordiniert den Entwurfsprozess, um Konsistenz zwischen den Mitgliedstaaten sicherzustellen.

| Verpflichtungsart | Anbieterverantwortlichkeiten | Anwenderverantwortlichkeiten |

|---|---|---|

| Inhaltskennzeichnung | Maschinenlesbare Ausgabelabels | Deepfakes klar offenlegen |

| Erkennungstools | Kostenlose Verifizierungs-APIs bereitgestellt | Gemeinsame Taxonomie-Standards verwenden |

| Laufende Pflichten | Post-Market-Mechanismen aufrechterhalten | Compliance-Verantwortung behalten |

| Schulung & Tests | Mitarbeiterschulung erforderlich | Redaktionelle Überprüfungsprozesse |

Dieser ausgewogene Ansatz respektiert Innovation und schützt gleichzeitig das Recht der Bürger zu wissen, was real ist.

Auswirkungen auf demokratische Prozesse und zukünftige Wähler

Regeln sind von geringer Bedeutung, wenn Schutzmaßnahmen dort versagen, wo Demokratie beginnt—an der Wahlurne. Diese KI-generierten Videos, die auf junge Zielgruppen abzielen, offenbaren besorgniserregende Lücken beim Schutz zukünftiger Wähler. Wenn synthetische Inhalte das politische Bewusstsein prägen, bevor Bürger kritisches Denken entwickeln, schwächen sich demokratische Grundlagen.

Die Reichweite der Kampagne zeigt drei ernste Bedenken auf :

- Jugendbeteiligung erfolgt durch manipulierte Inhalte statt durch ehrlichen Dialog

- Fast 200.000 Aufrufe verbreiten extreme Positionen an beeinflussbare Zielgruppen

- Ausländische Interessen prägen möglicherweise Polens politische Zukunft durch bewaffnete Medien

Junge Wähler verdienen authentische Informationen, um echte Meinungen zu bilden. Stattdessen überbringen fiktive Charaktere Botschaften, die darauf ausgelegt sind zu manipulieren, anstatt zu informieren. Diese koordinierte Anstrengung verbreitet nicht nur falsche Behauptungen—sie untergräbt grundlegend, wie die nächste Generation ihre Rolle in der Demokratie versteht. Die Videos zeigten Frauen, die in polnische nationale Symbole gekleidet waren, während sie Botschaften förderten, dass Polen aus der Europäischen Union austreten sollte. Den Schutz der Wählerautonomie bedeutet sicherzustellen, dass Plattformen nicht zu Werkzeugen für Massenbetrug werden können.

Quellenangabe

- https://www.polskieradio.pl/395/7784/artykul/3627461

- https://www.siliconrepublic.com/business/google-eu-probe-ai-youtube-data-content-antitrust

- https://www.aa.com.tr/en/europe/eu-launches-probe-into-googles-alleged-anti-competitive-practices-in-ai/3766458

- https://www.opus.pro/blog/eu-ai-act-content-creators

- https://techgdpr.com/blog/data-protection-digest-17072025-ai-generated-voice-and-visuals-potential-to-violate-peoples-rights-and-freedoms/

- https://www.youtube.com/shorts/uhA5WBBKq6A

- https://thecyberexpress.com/tiktok-ai-generated-disinformation/

- https://cadeproject.org/updates/poland-calls-on-commission-to-investigate-tiktok-over-ai-generated-disinformation/

- https://www.investing.com/news/company-news/tiktok-faces-polish-complaint-to-eu-over-alleged-russian-disinformation-4425631

- https://tvpworld.com/90822443/poland-asks-eu-to-probe-tiktok-over-ai-generated-content