Einen aktuellen Sicherheitsvorfall verstehen : Einblicke und Reaktionen

03/06/2024

KI-Wettbewerb und Fortschritt

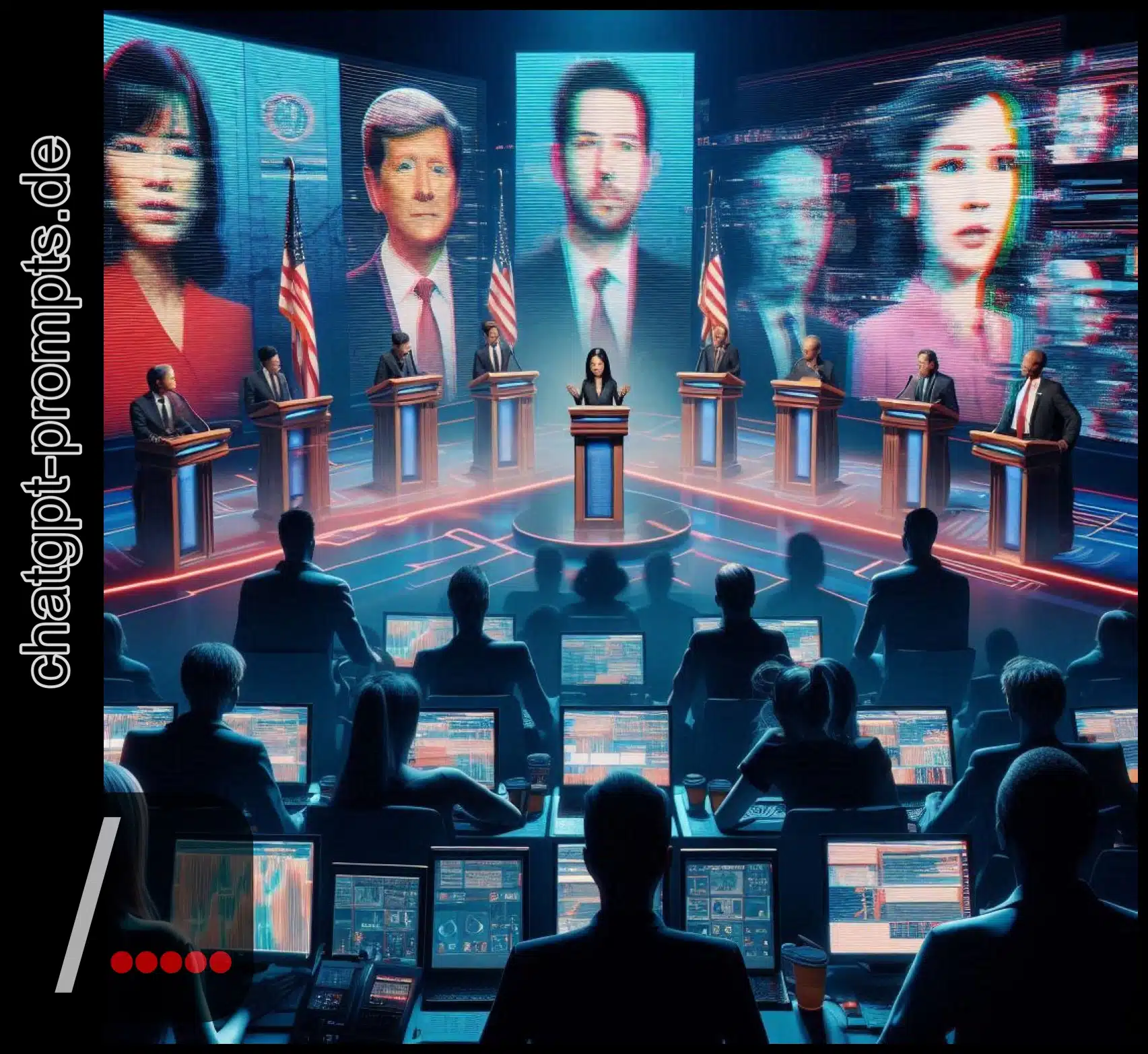

05/06/2024Die wachsende Bedrohung durch gefälschte Audio- und Videoaufnahmen in politischen Kampagnen ist eine ernstzunehmende Gefahr für die Integrität von Wahlen und das Vertrauen der Wähler. Die fortschreitende Entwicklung von Deepfake-Technologie und Diensten zum Klonen von Stimmen birgt das Risiko, dass Fehlinformationen weiter verbreitet werden. Dazu gehören gefälschte Robocalls und manipulierte öffentliche Bekanntmachungen. Es wird immer schwieriger, zwischen Realität und Fälschung zu unterscheiden. Dies schafft ein schwieriges Umfeld für die Unterscheidung der Wahrheit. Angesichts der bevorstehenden Wahlen im Jahr 2024 (und allen weiteren Wahlen, ganz gleich welches Land) sind strenge Vorschriften und eine strenge Aufsicht von entscheidender Bedeutung. Die Fortschritte in der Technologie werden zweifellos die Zukunft des politischen Diskurses und die Wahrnehmung der Wähler beeinflussen.

Die Deepfake-Technologie kann beeindruckend realistische Audio- und Videoinhalte produzieren, sodass es schwierig ist, zwischen Realität und Fälschung zu unterscheiden. Stellen Sie sich vor, Sie hören eine Rede eines politischen Führers, von der sich später herausstellt, dass sie komplett gefälscht ist. Diese Technologie hat das Potenzial, Fehlinformationen zu verbreiten, die öffentliche Meinung zu beeinflussen und das Vertrauen in den Wahlprozess zu untergraben.

Bei der Wahl 2024 müssen wir uns vor gefälschten Audio- und Videoaufnahmen von Politikern schützen. Das Potenzial von Deepfakes, demokratische Prozesse zu stören, ist groß. Deshalb müssen wir wachsamer sein und Sicherheitsvorkehrungen treffen, um die Integrität unserer Wahlen zu wahren.

Analyse von Stimmenklon-Diensten

Die Analyse von Stimmenklon-Diensten zeigt erhebliche Schwachstellen in politischen Kampagnen auf. Trotz des technologischen Fortschritts gelang es Diensten wie Speechify und PlayHT nicht, Stimmen oder falsche Aussagen zu blockieren. Descript, Invideo AI und Veed erfordern echte Audio-Uploads, können aber umgangen werden. ElevenLabs hat bewiesen, dass es 25 von 40 Fällen blockieren kann. Außerdem hat es Richtlinien gegen die Nachahmung von Personen des öffentlichen Lebens durchgesetzt.

Die Rolle von Invideo AI

Die Rolle von Invideo AI bei der Generierung und Verbreitung von Desinformationen zeigt kritische operative Lücken auf. Trotz zugesicherter Sicherheitsvorkehrungen hat die Plattform Schwierigkeiten, Aufnahmen zu blockieren, selbst wenn gefälschte echte Stimmen verwendet werden. Dieses Problem wird noch deutlicher, wenn die Technologie aus kurzen Aufforderungen Desinformationsskripte generiert, die effektiv Sprachmuster von bekannten Persönlichkeiten wie Präsident Biden imitieren. Diese Fähigkeit führt nicht nur zu überzeugenden Fälschungen, sondern ist auch ein Highlight der mangelnden Kontrolle.

Die Leichtigkeit, mit der die Plattform überzeugende, irreführende Inhalte erzeugt, zeigt, dass dringend strengere Richtlinien und Vorschriften erforderlich sind. Diese Unzulänglichkeiten sind ein Beispiel für die Herausforderungen, denen sich die Technologie stellen muss, um die Integrität und das Vertrauen in den politischen Diskurs zu erhalten.

Missbrauch im Wahlkampf

Der Missbrauch von gefälschten Audio- und Videodateien in politischen Kampagnen ist ein wachsendes Problem, das den demokratischen Prozess bedroht. Stellen Sie sich vor, Sie erhalten einen Telefonanruf, der genau wie Ihr Lieblingspolitiker klingt, aber die Nachricht ist verdreht, um falsche Informationen zu verbreiten. Obwohl dies von der FCC verboten ist, sind diese irreführenden Taktiken nur allzu verbreitet.

Auch öffentliche Bekanntmachungen können manipuliert werden. Stellen Sie sich vor, Sie sehen eine scheinbar echte Nachricht, die Sie zur Stimmabgabe auffordert, nur um dann festzustellen, dass sie von einer künstlichen Intelligenz erstellt wurde, um Sie in die Irre zu führen. In knappen Rennen können solche Täuschungen das Ergebnis beeinflussen und das öffentliche Vertrauen untergraben. Die Plattformen haben oft Mühe, die Regeln strikt durchzusetzen, was dieses Problem noch verstärkt. Diese digitale Manipulation verzerrt die Wahrheit und gefährdet die Integrität unserer Wahlen.

Der Zustrom dieser gefälschten Medienelemente kann politische Landschaften in ein verwirrendes Labyrinth aus Fehlinformationen verwandeln.

Politiker halten Reden, die sie nie gehalten haben, oder befürworten politische Maßnahmen, die sie in Wirklichkeit ablehnen. Diese Fälle von manipulierten Medien untergraben das öffentliche Vertrauen und verzerren die Wahrnehmung der Wähler. Umso dringlicher sind umfassende Regelungen, denn die Grenzen zwischen Realität und Erfindung verschwimmen mehr denn je.

Wir müssen proaktive Maßnahmen ergreifen, um die Integrität unserer politischen Systeme zu schützen. Dazu gehört die Entwicklung und Durchsetzung strenger Vorschriften zur Kontrolle der Erstellung und Verbreitung von Deepfakes. Wir müssen sicherstellen, dass unsere demokratischen Prozesse transparent und vertrauenswürdig bleiben.